Am 6. Januar 2021 wütet in Washington DC der Mob: Polizist*innen werden angegriffen, getreten und geschubst, chemische Reizstoffe kommen zum Einsatz. Mehrere Menschen sterben. Ein improvisierter Galgen wird aufgestellt, während aus der Menge „Hängt Mike Pence!“ schallt. Die Geräuschkulisse wird übertönt vom Lärm der Schlacht, Schutzschilde treffen auf Fahnenstangen. Der Mob trägt Trump-2020-Banner, viele schmücken sich mit rechtsextremen und reaktionären Symbolen oder Merchandise-Artikeln, darunter ein „Camp Auschwitz“-Shirt und die Konföderiertenflagge, die auf dem Kapitoldom gehisst wird.

Die Demonstration wurde vor allem online, über Plattformen wie Twitter (heute X) und Facebook, organisiert, um die Bestätigung der Wahl Joe Bidens zum nächsten Präsidenten zu verhindern. Der 2020 abgewählte Präsident Donald Trump selbst ruft am 18. Dezember 2020 auf Twitter zur Demo auf: „Statistisch gesehen ist es unmöglich, die Wahl 2020 verloren zu haben. Großer Protest in D.C. am 6. Januar. Seid dort, es wird wild!“

Und es war wild: Der Sturm auf das Kapitol, wie das Ereignis später genannt wird, ist ein beispielloser Moment politischer Unruhe in den USA – ein Putschversuch, der seinerzeit durchaus ernst genommen wird. So ernst, dass sogar Mark Zuckerberg, CEO von Meta, eine öffentliche Stellungnahme abgibt: „Wir glauben, dass die Risiken zu groß sind, wenn wir dem Präsidenten erlauben, unsere Dienste während dieser Zeit weiterzunutzen.“ Plattformen wie Facebook, Twitter und Google, die Trump und seinen Sympathisanten bis dahin weitgehend freie Hand ließen, setzen einen Schlusspunkt: Nicht nur Trumps Konten werden gesperrt, sondern auch die von Organisationen wie den Proud Boys, die aktiv am Sturm auf das Kapitol beteiligt waren. Das hat auch Effekte im deutschsprachigen Raum: Accounts von Einzelpersonen wie Martin Sellner, aber auch die von Organisationen wie Querdenken und anderen Antidemokrat*innen werden geschlossen.

Lichtblicke und Sinneswandel

Die Folge ist eine digitale Migration extremistischer Gruppen auf dezentralisierte Alt-Tech-Plattformen wie Telegram. Dort finden Reichsbürger*innen, Verschwörungsfanatiker*innen, Esoterikfans, russische Bots und andere demokratiefeindliche Akteur*innen einen sicheren Hafen, um gegen Demokratien weltweit aufzubegehren und Pläne zu schmieden. Auf den großen Plattformen von Meta und Co. zeigt sich zumindest ein vorübergehender Anschein von Vernunft.

Der Mutterkonzern von Facebook und Instagram intensiviert ab 2021 interne Schutzmaßnahmen: Weltweit werden etwa 40.000 Moderator*innen eingestellt, neue Technologien zur Inhaltsüberprüfung entwickelt und unabhängige Organisationen zur Faktenprüfung finanziert. Meta avanciert zum führenden Geldgeber für Programme zur Analyse terroristischer und extremistischer Inhalte.

Womöglich erhofft sich Mark Zuckerberg eine Art politische Reinwaschung, denn in der Vergangenheit stand die Plattform immer wieder im Zentrum von politischen Skandalen. Cambridge Analytica, angeblich mitverantwortlich für Brexit und Trumps Wahlerfolg 2016, hatte auf Facebook gesetzt. Die Whistleblowerin Frances Haugen hatte in den Facebook Files 2021 öffentlich gemacht, dass der Konzern ganz bewusst, an der Polarisierung der Gesellschaft mitwirkt, um Profite zu maximieren. Und auch bei der Eskalation ethnischer Konflikte in Myanmar im Jahr 2017 spielte die Social-Media-Plattform eine Rolle.

Richtungswechsel: Ungefilterter Hass

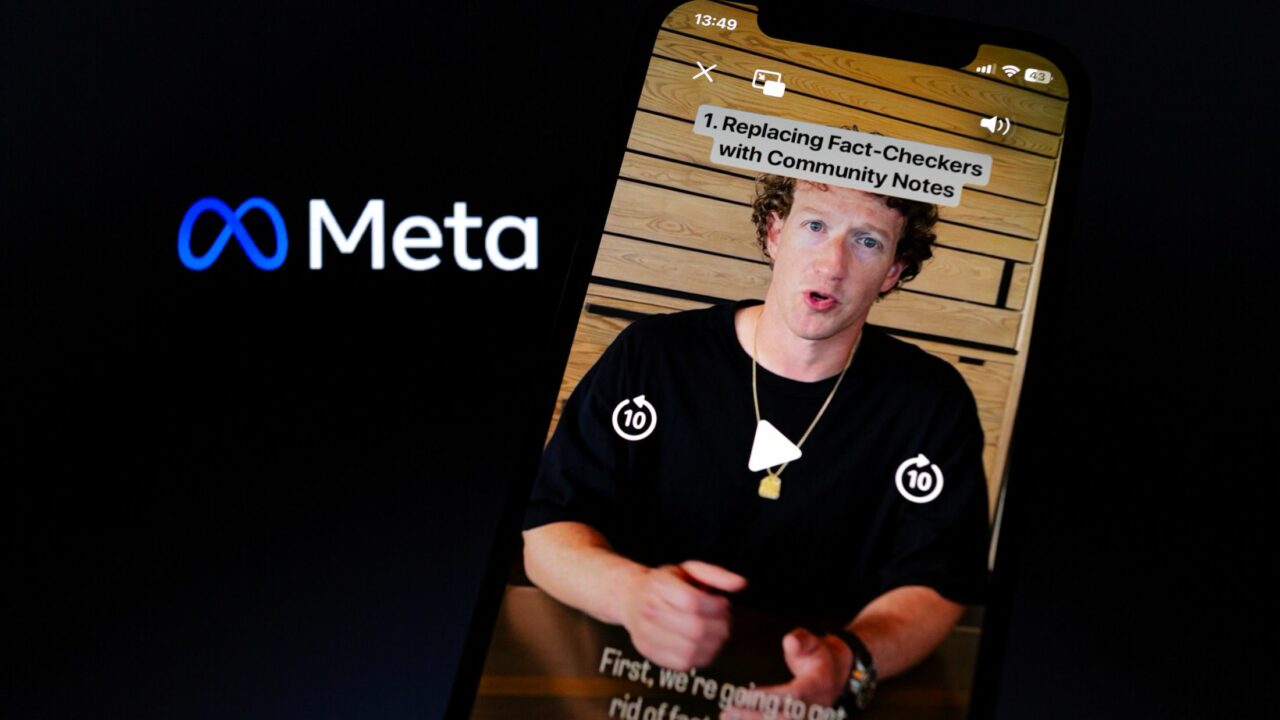

Nun hat sich der Wind jedoch erneut gedreht. Angesichts von Donald Trumps Wahlsieg und Elon Musks radikalem Kurs bei X kündigte Meta einen Richtungswechsel an. In einem Video auf den eigenen Plattformen verkündete Zuckerberg am 7. Januar persönlich die wichtigsten Änderungen der Unternehmensrichtlinien mit folgenden Worten:

„Es ist an der Zeit, uns auf unsere Wurzeln der freien Meinungsäußerung zu besinnen. Wir ersetzen Faktenchecker durch Community Notes, vereinfachen unsere Richtlinien und konzentrieren uns darauf, Fehler zu reduzieren. Wir freuen uns auf dieses nächste Kapitel.“

Die angekündigten Änderungen im Detail:

- Aufhebung von Beschränkungen: Meta wird sämtliche Beschränkungen für schädliche Meinungsäußerungen, einschließlich Hassrede, aufheben.

- Ende des Fact-Checking-Programms: Das Programm, das Drittorganisationen finanzierte, wird ab sofort eingestellt und durch ein freiwilliges Modell ersetzt, ähnlich dem von X. Das soll zunächst nur in den USA geschehen.

- Eingeschränkte Moderation: Automatisierte Moderationssysteme greifen nur noch bei schwerwiegenden Verstößen wie Terrorismus, Drogenhandel oder Pornografie ein. Themen wie Desinformation, Bots oder geistige Brandstiftung fallen nicht mehr unter die Moderation.

Problematische Inhalte werden auf Metas Plattformen massiv zunehmen – ähnlich, wie es mittlerweile auf X der Fall ist. Die wahrscheinlich größte Bedrohung geht jedoch von der Abschaffung der Faktenüberprüfung aus. Dies betrifft nicht nur die freie Verbreitung falscher Inhalte, sondern auch die Wahrscheinlichkeit, dass feindliche Drittstaaten wie Russland, Iran oder China das entstandene Vakuum mit Desinformation füllen.

Politisch destabilisierende Szenarien, wie die rumänische Wahl 2024, bei der ein unbekannter Rechtsextremist durch den Einsatz russischer Bots, eingekaufter Influencer und gezielter Desinformation fast ins Amt gelangt wäre, könnten künftig auch in anderen Demokratien zur Realität werden. Noch besorgniserregender ist die mögliche Etablierung einer kaputten Informationsumgebung, in der Meinungen Fakten vollständig verdrängen. Ein Anstieg von Desinformation und Populismus scheint unausweichlich, befeuert durch Plattformen, die sich ihrer Verantwortung entziehen und die Meinungsbildung sich selbst überlassen.

Studien zeigen, dass moderne Aufmerksamkeitsökonomien emotionalisierende, falsche Inhalte bevorzugen. Hinzu kommt die Aufhebung von Beschränkungen für Meinungsäußerungen, die zuvor als schädlich eingestuft wurden – ein perfekter Nährboden für Hassrede. Transfeindlichkeit, Frauenfeindlichkeit, Rassismus, Flüchtlingsfeindlichkeit und Antisemitismus.

Besonders folgenschwer ist die drastische Reduzierung der Moderationskapazitäten bei Meta. Algorithmen, die bisher darauf trainiert waren, menschenfeindliche Inhalte zu erkennen und zu verhindern, werden künftig kaum noch greifen. Dieses Spiel mit dem Feuer setzt Millionen von Menschen realer Gefahr aus, schwächt Demokratien durch externe Einflussnahme und verroht den Meinungskorridor weiter zugunsten von Rechtsextremen und anderen antidemokratischen Akteur*innen.

Die Auswirkungen von Hassrede und Desinformation in sozialen Medien sind längst bekannt. Doch was passiert, wenn zusätzlich reale Krisen und Weltereignisse auf diese fragile Plattform-Infrastruktur treffen? Menschen suchen in Krisenzeiten nach Antworten. Wer fragt, „Was ist passiert?“, oder „Was sind die Ursachen von Ereignis X?“ könnte bald noch mehr verschwörungsideologische, populistische oder extreme Antworten finden. Krisen sind ein gefundenes Fressen für Hass- und Trollmaschinerien, die gezielt Verunsicherung und Polarisierung befeuern.

Der DSA und Europa

Einige mögen argumentieren, dass solche Entwicklungen in Europa durch den Digital Services Act (DSA) reguliert werden könnten. Zwar existiert diese Richtlinie theoretisch, doch die praktische Umsetzung steht auf einem anderen Blatt. Die rechtlichen Rahmenbedingungen des DSA greifen zwar, doch es mangelt an einer ausreichenden Institutionalisierung. Aktuell werden sowohl Regierungen als auch zivilgesellschaftliche Initiativen weitgehend allein gelassen.

Es ist offensichtlich, dass gesellschaftliche Antworten und eine stärkere Institutionalisierung erforderlich sind. Doch der Weg dahin ist steinig, blockiert durch Bürokratie, fehlende Ressourcen, politische Instabilität und populistische Gegenmaßnahmen. Konkret steht Europa vor der Herausforderung, diesen Missstand durch Klagen und gesamtgesellschaftliche Reaktionen zu überwinden.

Es braucht zweifelsohne eine Institutionalisierung der Plattformaufsicht, sodass unabhängige Behörden, die Einhaltung des DSAs überwachen und Verstöße konsequent ahnden. Mehr noch sollte genau zu diesem Zeitpunkt massiv in digitale Resilienz, Medienbildung und Informationskompetenz investiert werden. Die Antwort liegt gleichzeitig auch im europäischen Alleingang und in der Schaffung von Alternativen, wie etwa anderer Plattformen oder anderer Vorbilder und schlussendlich in die stärkere Unterstützung von Zivilgesellschaft auf gesamteuropäischer Ebene als Reaktion auf Populismus, Instabilität und antidemokratischem Rollback. Immerhin: Europa hat aktuell die Chance aus den Fehlern anderer Länder zu lernen, um in einer Zeit der Plattformresignation, eine Vorreiterrolle für eine neue Ära der digitalen Demokratie zu übernehmen.