Die Plattform TikTok ist für ihre kurzlebigen Unterhaltungsinhalte bekannt: Lustige Tiervideos, bunte Farbspiele oder aktuell beliebte Tänze. Aber dann gibt es auch andere Beiträge. Menschen, die in Militäruniform zu Technomusik dem Neonazi-Symbol der „Schwarzen Sonne” im Hintergrund huldigen. Auch Accountnamen wie „Combat18“, „GlorytoAWD“ oder Profilbilder von Rechtsterroristen passen nicht so richtig ins Bild der bunten Entertainment-Plattform. Und doch sind die dort anzutreffen.

Für Kinder und Jugendliche eine Gefahr

„Es ist nicht verwunderlich, dass auch Rechtsterrorist:innnen die Plattform für ihre Zwecke nutzen wollen“, sagt Eva Kappl, die das Bildungsprojekt Demokratiktok der Amadeu Antonio Stiftung betreut, das Radikalisierungsprävention und Informationsangebote auf TikTok bereitstellt. Die Plattform biete für Rechtsextreme viele Vorteile. „Dazu gehört unter anderem, dass Nutzer:innen auf TikTok eine hohe Reichweite erzielen können, ohne selbst viele Follower:innen haben zu müssen,“ so Kappl. Vor allem der Algorithmus sei eine Gefahr, denn dieser sei explizit auf die Interessen von Nutzer:innen zugeschnitten: „Sofern bei Kindern und Jugendlichen bereits ein Interesse und eine Nähe zu diesen Themen besteht, kann die Plattform zu einer weiteren Radikalisierung beitragen.“

Dabei fungiert TikTok nicht nur als Werbefläche für menschenfeindliche Ideologien, sondern scheint für einige auch der Zugang in abgeschiedenere Onlinebereiche zu sein. In diesen Gruppen sind menschenverachtende Inhalte, die Verehrung von Massenmördern oder Aufrufe zu gezielten Shitstorms bei anderen TikTok-User:innen an der Tagesordnung, wie die Recherche von Belltower.News in einer dieser Gruppen zeigt.

„How can I join?”: TikTok als Zugang für radikalere Kanäle

Der Weg in die Gruppe führt über TikTok-Accounts, die einen Zugangslink für einen Telegramchat in ihrer Biografie teilen. Ein Klick und man wird Teil der Gruppe, die sich wortgemäß übersetzt „Europäische nationalsozialistische Ordnung“ nennt. Die Voraussetzung zum Bleiben: man muss ein Foto seines Armes machen, um sein eigenes Weißsein zu beweisen. Anschließend hat man vollen Zugriff auf jegliches menschenverachtende und volksverhetzende Material.

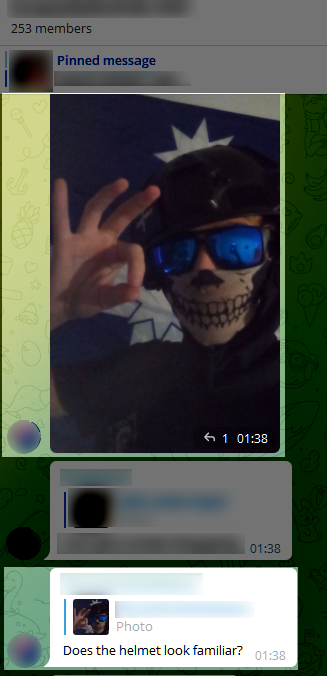

Neben Hakenkreuzen und den Livevideos von rechtsterroristischen Attentätern wie dem vom Christchurch, geben Mitglieder der Telegramgruppe ungehemmt Einblicke in ihre eigene menschenhassende Gesinnung. Jugendliche posten Bilder von sich mit Hitlergruß oder ihrem scheinbar tristen Schulalltag. Viele sind minderjährig. Ein deutsches Mitglied postet ein Bild von sich, vermummt, und mit Deutschlandfahne, andere zeigen stolz eigene Ausrüstungsgegenstände wie Macheten oder Softair-Waffen. Andere hoffen durch die Gruppe in Kontakt mit anderen rechtsterroristischen Gruppierungen zu kommen. „Anyone in Atomwaffen Divison“, fragt ein deutschsprachiges Mitglied, „How can I join“?

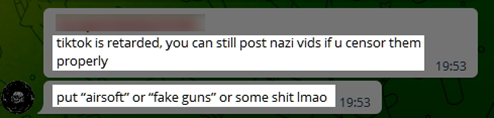

Viel in der Kommunikation dreht sich aber auch um TikTok. Mitglieder geben an, über TikTok auf die Gruppe aufmerksam geworden zu sein und prahlen damit, wie oft ihre Accounts bereits gesperrt wurden oder beschweren sich, dass das Hochladen von Neonazivideos kaum noch möglich sei. Aber auch für diesen Fall helfen andere aus und geben Tipps, wie Sperrungen durch andere Begrifflichkeiten umgangen werden können.

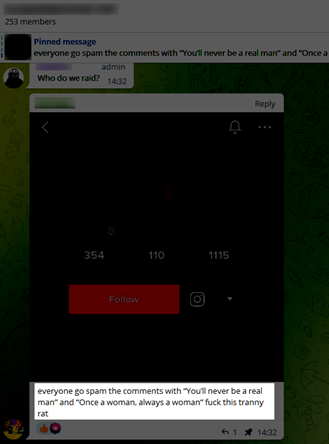

Angeleitete Shitstorms: Wenn der Hass von Telegram TikToker:innen trifft

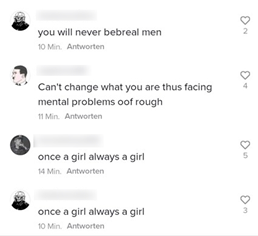

Besonders wichtig scheint einem der Admins zu sein, dass der Hass nicht nur in der Gruppe bleibt, sondern auch nach außen getragen wird, beispielsweise auf TikTok. So fordert er die Gruppenmitglieder auf, den TikTok-Account eines Minderjährigen mit Hasskommentaren zu überschwemmen. Seine Follower:innen reagieren schnell und kopieren den Hass routiniert unter die Videos des Opfers. Nach erfolgreicher Aktion löscht der Admin seinen Auftrag in der Gruppe.

TikTok gibt auf Anfrage von Belltower.News an, dass man an der Bekämpfung von Hassrede arbeite. Man schule seine Moderation kontinuierlich und dulde keine „Inhalte, in denen hasserfüllte Ideologien gepriesen, gefördert, verherrlicht oder unterstützt werden“. Außerdem habe man im Vergleich zum Jahresanfang 2021 16,2 Prozent mehr Inhalte, die unter die Kategorie des gewalttätigen Extremismus fallen würden, zum Jahresende entfernen können, ohne, dass die Inhalte überhaupt jemand gesehen hat. Zur Frage, ob sich das Unternehmen der Weiterleitungen in möglicherweise weiter radikalisierende Kanäle bewusst ist, äußerte sich TikTok nicht, aber man gehe auch gegen Konten vor, die abseits von TikTok mit Hassrede in Verbindung gebracht werden können. Die in der Recherche angesprochen Accounts sind mittlerweile entfernt worden.

Eva Kappl sieht allerding noch deutlich Luft nach oben. „Diese Recherche zeigt, dass die Umsetzung der Richtlinien aktuell nur bedingt funktioniert. Die Moderationsteams von TikTok müssen dringend geschult werden, um diese Inhalte schneller zu erkennen und handeln zu können.“

Derweil legen sich die gesperrten Nutzer:innen auf TikTok neue Profile in leicht abgeänderter Form an. Die Routine ist eingespielt und anstatt der vier gelöschten Profile lässt sich nun mit fünf prahlen.